Piyasa

Yapay Zekâ Krizi Savaşa Taştı: Okul Bombardımanı Sonrası Pentagon’a Şok Dava

ABD’de yapay zekâ, savaş politikaları ve kamu ihale süreçleri etrafında büyüyen yeni bir kriz, hem siyasi hem hukuki açıdan dikkat…

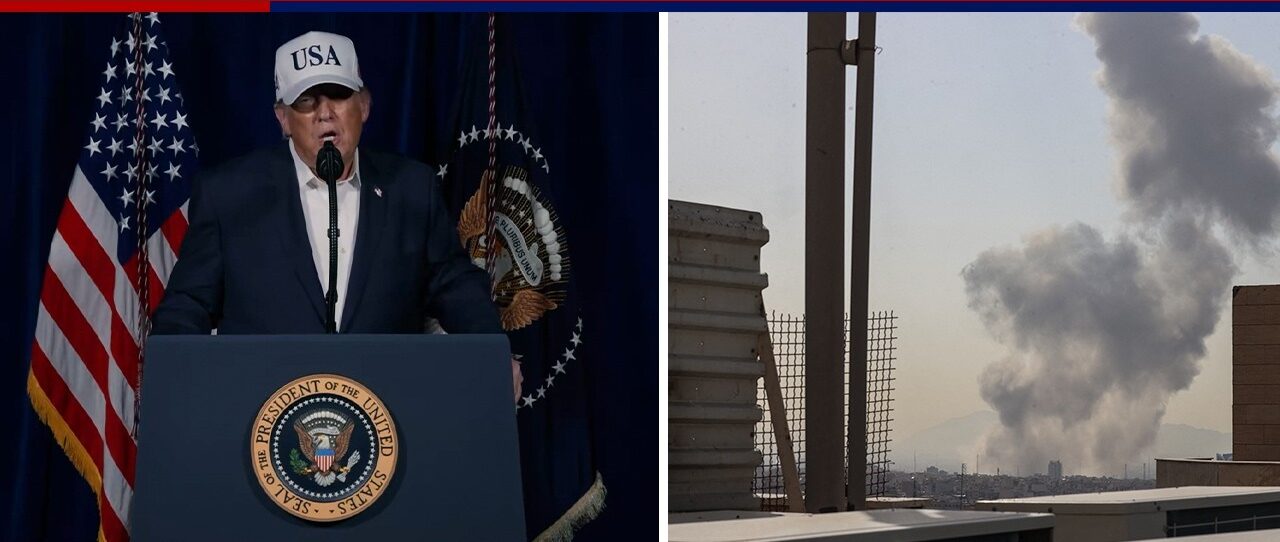

ABD’de yapay zekâ, savaş politikaları ve kamu ihale süreçleri etrafında büyüyen yeni bir kriz, hem siyasi hem hukuki açıdan dikkat çekici bir tartışmanın merkezine yerleşti. Savunma alanında kullanılan yapay zekâ yazılımlarına hangi sınırlar içinde izin verileceği sorusu, İran savaşı sırasında yaşanan sivil can kayıpları iddialarıyla birlikte çok daha sert bir gündeme dönüştü. Özellikle bir kız okulunun hedef alındığı saldırı sonrası ortaya çıkan sorular, yalnızca askeri karar alma süreçlerini değil, teknoloji şirketleri ile devlet arasındaki ilişkinin sınırlarını da yeniden tartışmaya açtı.

Tartışmanın odağında, bir yapay zekâ şirketinin ABD Savunma Bakanlığı ve üst düzey yetkililere karşı açtığı dava bulunuyor. Şirket, hükümetin kendilerini kamu ihalelerinden dışlamak için hukuka aykırı biçimde “tedarik zinciri riski” ilan ettiğini savunuyor. Bu adımın yalnızca ticari bir anlaşmazlık değil, aynı zamanda ifade özgürlüğü, adil işlem hakkı ve devlet gücünün özel şirketler üzerindeki baskısı açısından da kritik bir mesele olduğu belirtiliyor.

Yapay zekâ kullanımı üzerindeki anlaşmazlık büyüdü

Sürecin merkezinde, savunma amaçlı yapay zekâ kullanımına dair iki temel şart bulunuyor. Şirketin iddiasına göre Pentagon ile daha önce yürütülen görüşmelerde, teknolojinin kullanımına ilişkin iki net sınırlama önerildi. Bunlardan ilki, yazılımın Amerikan vatandaşları üzerinde kitlesel gözetim amacıyla kullanılmamasıydı. İkincisi ise, yapay zekâ herhangi bir silah sisteminde ya da ölümcül bir operasyon sürecinde yer alacaksa, son kararın mutlaka bir insan tarafından verilmesi gerektiğiydi.

Şirkete göre bu iki şart, hem etik açıdan hem de mevcut teknoloji düzeyi bakımından son derece makuldü. Çünkü yapay zekâ sistemleri, büyük veri işleme ve analiz yeteneklerine sahip olsa da, hâlâ hatalı sonuç üretme riski taşıyor. Özellikle savaş gibi saniyeler içinde ölüm kalım kararı verilen ortamlarda, yalnızca algoritmalara güvenilmesinin ciddi felaketlere yol açabileceği düşünülüyor.

Ancak şirket, bu maddelerin savunma makamları tarafından kabul edilmediğini öne sürüyor. İddiaya göre yetkililer, bu açık sınırlamalar yerine daha genel ve yoruma açık bir ifade kullanılmasını istedi. Yazılımın yalnızca “yasalara uygun biçimde” kullanılacağına dair geniş bir çerçeve önerildi. Şirket ise bu tür belirsiz bir ifadenin, gerçek bir güvence sağlamadığını savundu. Çünkü hangi hukukun esas alınacağı, iç hukuk ile uluslararası hukuk arasında nasıl bir yorum yapılacağı ve askeri kuralların nasıl uygulanacağı net değildi.

“Tedarik zinciri riski” kararı davalık oldu

Tartışmanın asıl büyüdüğü nokta ise şirketin kamu ihalelerinden fiilen dışlanmasına yol açan karar oldu. Şirket, kendilerine karşı alınan “tedarik zinciri riski” kararının teknik ya da güvenlik gerekçeleriyle değil, siyasi nedenlerle verildiğini ileri sürüyor. Bu damga, yalnızca bir kamu kurumuyla yaşanan sözleşme sorunu anlamına gelmiyor. Aynı zamanda şirketin başka devlet ihalelerine girmesini de zorlaştırıyor, hatta bazı özel sektör ortaklıklarını bile riske atıyor.

Dava dosyasındaki temel iddia, bu kararın anayasal haklara aykırı bir cezalandırma olduğu yönünde. Şirket, güvenlik ilkeleri ve etik sınırlar konusunda itiraz ettiği için hedef haline getirildiğini savunuyor. Bu nedenle açılan davada ifade özgürlüğü, adil yargılanma hakkı ve idarenin keyfi işlem yapamayacağı ilkesine vurgu yapılıyor.

Uzmanlara göre böyle bir etiketin bir teknoloji şirketine yapıştırılması, yalnızca bugünkü gelir kaybı anlamına gelmiyor. Aynı zamanda gelecekte alınabilecek yüz milyonlarca dolarlık savunma ve teknoloji sözleşmelerini de tehlikeye atıyor. ABD’de kamu kaynaklı yatırımların teknoloji sektöründe çok büyük bir rol oynadığı biliniyor. Özellikle savunma, yapay zekâ ve ileri teknoloji alanlarında devletle kurulan ilişkiler, şirketlerin büyümesinde belirleyici hale geliyor. Bu yüzden kara listeye alınmak, bazı şirketler açısından neredeyse varoluşsal bir tehdit olarak görülüyor.

Okul saldırısı tartışmayı daha da ağırlaştırdı

Tüm bu hukuki kavga, İran savaşı sırasında yaşanan bir bombardıman nedeniyle çok daha hassas bir boyut kazandı. Çünkü kamuoyunda büyük tepki çeken olaylardan biri, bir okulun vurulması oldu. İddialara göre saldırıda hedef alınan yerin okul olduğu, kamuya açık haritalar ve görüntüler üzerinden bile anlaşılabiliyordu. Bu nedenle, hedef tespit sürecinde ciddi bir hata yapılıp yapılmadığı sorusu gündeme geldi.

Bazı siyasetçiler ve uzmanlar, bu saldırının nasıl planlandığını, hangi araçların kullanıldığını ve hedef doğrulamasının hangi yöntemle yapıldığını sorgulamaya başladı. Özellikle yapay zekâ destekli analiz sistemlerinin devrede olup olmadığı sorusu öne çıktı. Çünkü eğer kamuya açık verilerde bile bir yapının okul olduğu görülebiliyorsa, buna rağmen hedef alınması iki ihtimali gündeme getiriyor: Ya ağır bir insan hatası yapıldı ya da otomatik analiz süreçleri yeterince denetlenmeden devreye sokuldu.

Saldırının ilk operasyon günlerinde gerçekleşmiş olması da soru işaretlerini artırdı. Çünkü bu tür hedeflerin çoğu zaman önceden belirlendiği, istihbarat ve askeri planlama süreçlerinden geçirilerek listeye alındığı biliniyor. Dolayısıyla yanlış hedefleme iddiası, sadece sahadaki bir hata değil, daha geniş bir sistem sorunu olarak görülüyor.

İnsan denetimi tartışması yeniden alevlendi

Yaşananların ardından en çok konuşulan başlıklardan biri, ölümcül askeri karar süreçlerinde insan denetiminin zorunlu olup olmaması oldu. Teknoloji şirketinin ısrarla savunduğu “nihai karar mutlaka insanda olmalı” şartı, okul saldırısı sonrasında çok daha somut bir anlam kazandı. Çünkü yapay zekâ sistemleri her ne kadar hızlı çalışsa da, bir hedefin askeri tesis mi yoksa sivil bina mı olduğunu her zaman doğru biçimde ayırt edemeyebilir.

Burada asıl mesele yalnızca teknik hata ihtimali değil. Aynı zamanda ahlaki ve hukuki sorumluluğun kimde olacağı sorusu da önem taşıyor. Bir algoritmanın verdiği tavsiye sonucunda siviller hayatını kaybederse, bunun hesabını kim verecek? Yazılımı geliştiren şirket mi, sistemi kullanan komutan mı, siyasi karar vericiler mi, yoksa emir komuta zincirinin tamamı mı?

Bu sorular henüz net yanıt bulmuş değil. Ancak bir noktada geniş bir uzlaşı oluşuyor: Yapay zekâ sistemleri, insan denetimi olmadan ölümcül operasyonlarda tek belirleyici unsur haline gelirse, hesap verilebilirlik zayıflayabilir. Bu da savaş hukukundan insan haklarına kadar uzanan çok geniş bir alanda yeni krizler doğurabilir.